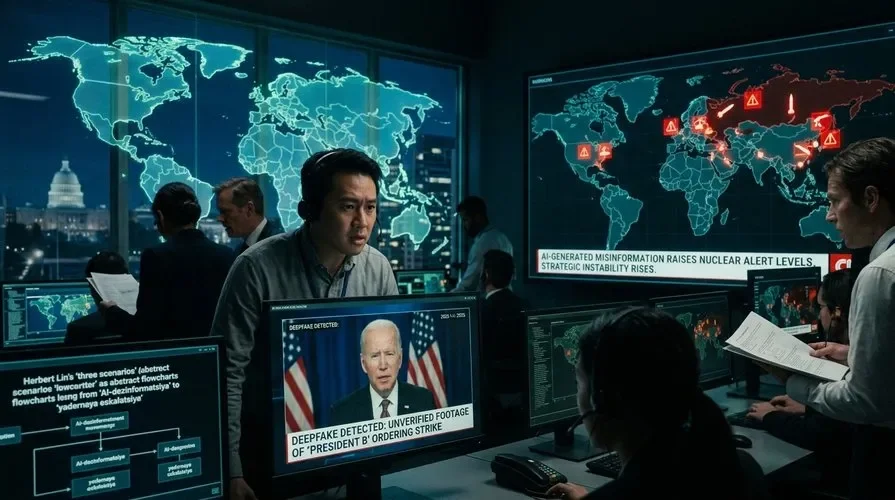

Когда технологии подводят: ИИ на войне и его ошибки

Век искусственного интеллекта: когда ошибки становятся на совести машин 💻🤖

Привет, друзья! Давайте поговорим о том, как технологии вмешиваются в самые серьезные сферы нашей жизни. Занимаетесь ли вы военной темой или просто интересуетесь новинками, знаете ли вы, что американские военные решили использовать искусственный интеллект (ИИ) для определения целей в конфликтах? Но вот беда, как выясняется, машинные ошибки могут иметь фатальные последствия.

Зачем ИИ в военных операциях?

Что происходит, когда ИИ принимает важные решения на поле боя? Мы знаем, что стоит за новейшими технологиями: алгоритмы, разработанные Palantir Technologies, с помощью программы Maven Smart System, помогают Пентагону определять цели на карте. И вот тут-то и начинаются проблемы. 🤔

Сначала все выглядело многообещающе. ИИ проанализировал данные, обозначил около тысячи объектов для потенциальных уд�аров. Система занималась не только определением координат, но и расставляла цели по приоритетам. И, казалось, все идет хорошо, пока не произошел инцидент, который привел к трагическим последствиям.

Когда технологии ошибаются

Как сообщает газета The New York Times, ИИ допустил ошибку и нанес удар по школе в городе Минаб, где находились дети. Страшно подумать, что, хоть алгоритмы и быстро обучаются, они все еще не «человеческие». 😞

В тот же день, когда ударили по зданию школы, атака произошла и на соседнюю военно-морскую базу Корпуса стражей исламской революции. Итог? По меньшей мере 175 жертв, и большинство из них – ни в чем не повинные дети. Трагедия, которая была спровоцирована недостаточной точностью алгоритмов.

На кого свалить вину? 🤷

Сейчас в ходе расследования поднимается вопрос: может ли Пентагон переложить вину за ошибку на искусственный интеллект? Опасность такая существует. Некоторые правозащитники уже подняли тревогу, утверждая, что использование ИИ размывает границы ответственности между операторами и технологиями.

Более того, это уже бывалые ситуации в истории: от ошибок на поле боя до внезапно «сошедших с курса» ракет. ИИ становится удобной отговоркой для военных. Но давайте не будем забывать – в любой ситуации человек остается частью процесса принятия решения.

Кто за все отвечает? 🤔

Военные эксперты, включая бывших сотрудников Пентагона, отмечают, что система не может полностью самостоятельно принимать решения. Алгоритмы предлагают цели, анализируют данные, но именно человеческий фактор остается ключевым. Таким образом, ответственные лица должны нести свою долю вины. Поэтому, если произошла ошибка, это также должно лечь на плечи генералов и командиров, утвердивших «умные» данные, а не только на программное обеспечение.

Что дальше?

Что же ждет компании, разработавшие эти алгоритмы? На днях Белый дом объявил, что компания Anthropic, разработчик алгоритма Claude, представляет угрозу для национальной безопасности. В результате все новые контракты были приостановлены. 🛑

Несмотря на то что у Пентагона есть лишь один подрядчик в сфере ИИ, они задали ему ультиматум о пересмотре условий сотрудничества. Интересно, что эта компания уже пыталась инициировать судебные разбирательства с правительством, так как они уверены, что их подталкивают к нарушению законов. Теперь они однозначно оказались в сложной ситуации, а всё их будущее сотрудничество находится под вопросом.

Эксперты не исключают, что теперь Anthropic может населения в качестве «козла отпущения». Они заинтересованы не столько в исправлении ошибок, сколько в том, чтобы снять с себя ответственность. Поэтому американцы могут не жаждать поисков справедливости, если их какие-то действия окажутся двойными.

Искусственный интеллект и военная реальность 🚀

На фоне всех этих событий остается необходимость осознания, как ИИ применяется в реальных конфликтах. Эксперты советуют быть внимательными — сейчас самые важные решения зависят не только от алгоритмов, но и от человеческого контроля. Важно четко понимать, что, хоть технологии и развиваются, они все еще могут совершать ошибки, особенно в стрессовых и сложных условиях боевых действий, где действуют противники, есть информационный шум и разрушительные факторы.

Программное обеспечение функционирует не без ошибок, ошибки его могут привести к ужасным последствиям. В конечном итоге восстановление былой репутации также будет нелегкой задачей:

- Вскоре возможны и другие обвинения.

- Пентагон может начать перекладывать вину на программистов.

- Легитимность программного обеспечения будет подвергнута сомнению.

Заключение

В мире, где техно�логии стремительно развиваются, важно помнить о том, что человечество по-прежнему отвечает за свои решения. Сложная реальность войны требует от нас не только военных стратегий, но и глубокого понимания того, как взаимодействуют человек и машина.

Давайте будем надеяться, что вскоре бороться с последствиями ошибок будет куда легче и эффективнее. Важно видеть различия между алгоритмами и человеческими действиями, чтобы не допускать повторения трагедий. Ведь все мы – люди, и глубоко уважаем личные жизни и безопасность каждого.

Поддерживайте диалог, делитесь мнениями и оставайтесь в курсе событий! 🌍

Комментарии 0