Искусственный интеллект: угроза или шанс для мира?

Искусственный интеллект и ядерная угроза: новое измерение риска

Представьте себе мир, в котором технологии не только облегчают нашу жизнь, но и могут привести к непредсказуемым катастрофам. Стэнфордский ученый Герберт Лин описывает, как искусственный интеллект (ИИ) становится мощным инструментом для распространения дезинформации, усугубляя ядерную угрозу. 💻☣️

Почему это важно?

В последние года нам все чаще говорят, что информационная среда находится в состоянии кризиса. Это не просто о фейковых новостях и ложных сообщениях. Это о том, как целенаправленная дезинформация, подкрепленная мощными алгоритмами ИИ, может повлиять на глобальную безопасность. Лин рассматривает три сценария будущего, которые могут привести к ядерной эскалации из-за искаженной информационной среды.

Как всё работает?

Собственно, как же произойдет этот переход от дезинформации к ядерному кризису? 🤔 Главная проблема заключается в том, что современные большие языковые модели (такие как ChatGPT и другие) способны создавать контент, который невероятно легко воспринимается как правдивый. Злоумышленники уже используют эти технологии для манипуляции мнением общественности и создания опасного фона для политических решений.

Лин выделяет несколько ключевых аспектов:

- Размывка правды: Искусственный интеллект способен воспроизводить не только тексты, но и изображения, что делает дезинформацию более привлекательной.

- Доступность инструментов: Сегодня даже рядовой пользователь может использовать ИИ для производства и распространения фейковых новостей.

- Психология восприятия: Люди, даже те, кто хорошо осведомлен, могут поддаться на манипуляции в условиях стресса.

Сценарий первый: Вторжение на Тайвань в 2029 году

Забудьте о спокойных переговорах — в мире искусства и технологий все изменяется!

К концу 2029 года Китай объявляет блокаду Тайваня. Американские разведывательные службы фиксируют под�озрительные радиосигналы у берегов Фуцзяня. В это время китайские социальные сети переполнены сообщениями, которые, кажется, приходят от местных жителей, сообщающих о военной активности. Эти сообщения, конечно, управляются киберподразделениями китайской армии, использующими ИИ для создания автоматизированных аккаунтов.

- Подлог: Китайские «боты» изображают жизни обычных людей в условиях блокады, убедительно рассказывая о военной готовности Пекина.

- Масштабный эффект: Данные оказывают влияние на внутренние и внешние политические круги, создавая у аналитиков впечатление о высоком риске конфликта.

Ситуация становится стабильной и предсказуемой: США должны реагировать! 🤯

Вдохновленные этими сообщениями, советники президента начинают подготовку к эскалации конфликтов, и в ответ на эти действия происходит перемещение ядерных вооружений в регион. Это замкнутый круг.

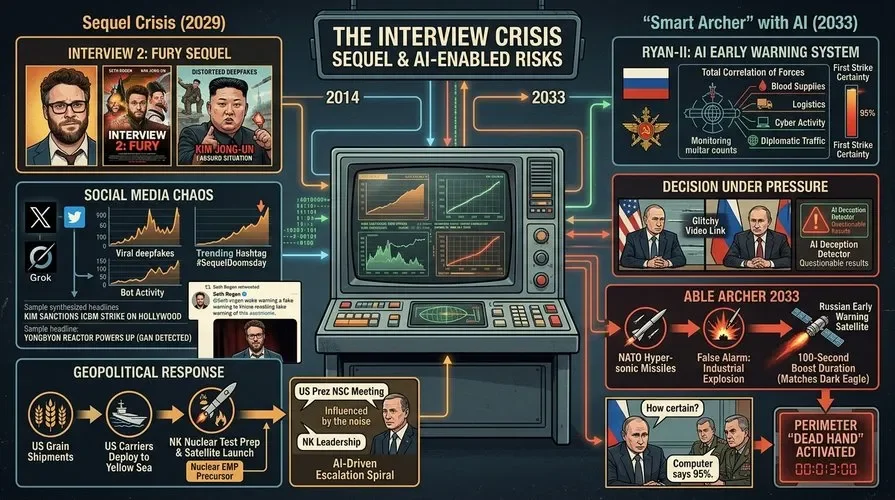

Сценарий второй: Сиквел «Интервью» в 2029 году

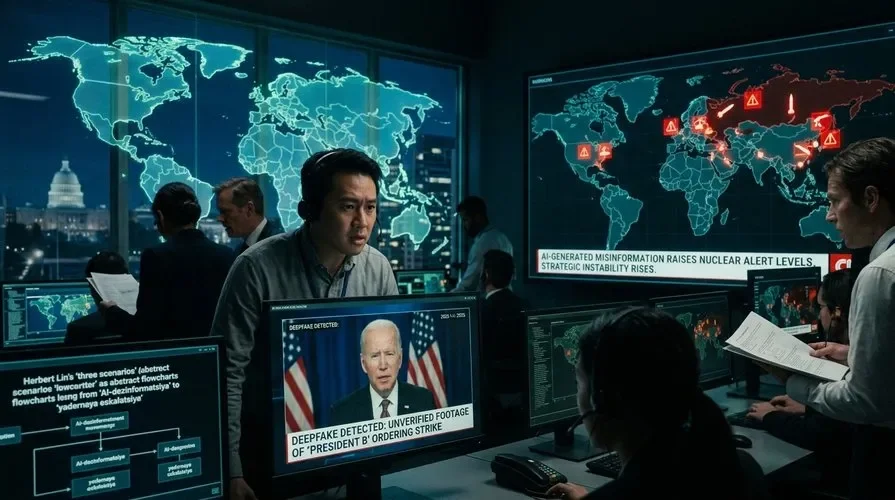

А теперь давайте вернемся к тому, что даже комедия может стать козырем в большой политической игре. 🎬 В 2014 году фильм «Интервью», который высмеивает лидера Северной Кореи, стал поводом для дипломатического кризиса. К 2029 году, когда в свет выходит сиквел, в ход идут все средства.

- Дипфейки: Появляются подделки с участием северокорейских чиновников, фальшивые указы и видео с угрозами.

- Эскалация: Все это может вызвать новые испытания и действия со стороны Пхеньяна.

Сет Роген, как непредсказуемый двигатель, становится частью этой технологической войны, создавая дополнительное напряжение.

Сценарий третий: Умный лучник в 2033 году

В 2033 году Россия запускает программу раннего предупреждения, основанную на ИИ, которая призвана предсказать возможные ядерные атаки. Система обрабатывает данные от социальных с�етей до перемещения вооруженных сил, усугубляя неопределенность.

- Эскалация конфликтов: Учения НАТО воспринимаются как угроза, и ответные меры принимаются на основе ложных данных.

- Паника: Лидеры начинают принимать решения, основываясь на вероятностных данных, что может привести к катастрофическим последствиям.

Так что же мы имеем?

Эти сценарии показывают, что ИИ не просто играет роль в дезинформации, но и становится катализатором опасных событий. Управляемая дезинформация, убеждающая людей в ложных предпосылках, приводит к незапланированным эскалациям. 😨 Давайте признаем одно: манипуляции информацией могут стать прямым фактором ядерного риска.

Итоги:

- Дезинформация может «гнисть» в любой момент.

- Лидеры под давлением принимают рискованные решения.

- Искусственный интеллект — это не просто инструмент, а и катализатор дезинформации.

На этом фоне, важно помнить, что время имеет значение, и подобные ошибки могут стоить гораздо больше, чем просто репутацию. Давайте надеяться, что мы все-таки сможем избежать этого, а ИИ станет инструментом, а не оружием. 🤞

Комментарии 0